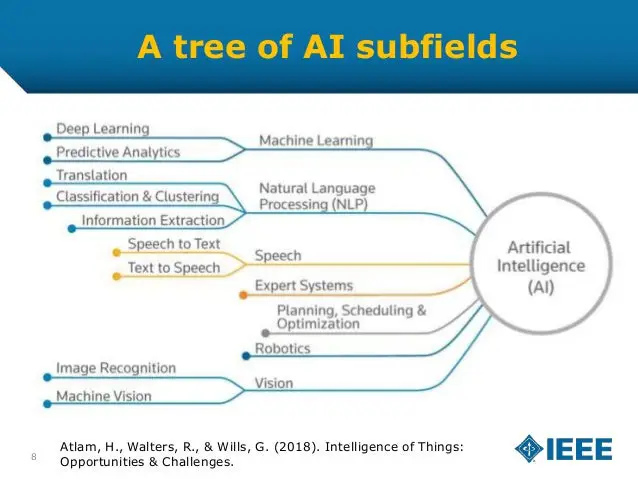

Dalam dunia teknologi yang terus berkembang pesat, kecerdasan buatan (AI) atau machine learning (ML) telah menjadi kekuatan pendorong utama di berbagai sektor. Dari sistem rekomendasi yang memprediksi preferensi kita hingga algoritma yang mengoptimalkan proses industri, ML telah mengubah cara kita hidup dan bekerja. Namun, di balik kemajuan ini, terdapat tantangan yang perlu diatasi, salah satunya adalah bagaimana kita dapat ‘mengalahkan’ atau ‘mengatasi’ keterbatasan ML. Artikel ini akan membahas berbagai strategi dan pendekatan dalam upaya defeat ML, mengeksplorasi kerentanan sistem ML dan bagaimana kita bisa memanfaatkannya.

Perlu dipahami bahwa ‘mengalahkan’ ML bukanlah tentang menciptakan sistem yang secara mutlak mengalahkan setiap algoritma ML yang ada. Tujuannya lebih kepada pemahaman mendalam tentang bagaimana sistem ML bekerja, mengeksplorasi batasan-batasannya, dan memanfaatkan kelemahan tersebut untuk tujuan tertentu, seperti meningkatkan keamanan sistem, mendeteksi bias, atau bahkan menciptakan sistem ML yang lebih robust.

Salah satu pendekatan untuk defeat ML adalah dengan memahami data yang digunakan untuk melatih model ML. Data yang bias, tidak lengkap, atau mengandung noise dapat mengakibatkan model ML yang tidak akurat dan mudah dimanipulasi. Dengan mengidentifikasi dan memanfaatkan kelemahan data ini, kita dapat menghasilkan input yang menyebabkan model ML memberikan output yang tidak diinginkan atau salah.

Contohnya, sebuah model ML yang dilatih untuk mengidentifikasi gambar kucing mungkin akan salah mengidentifikasi gambar kucing yang memiliki pose atau sudut pandang yang tidak biasa. Dengan memahami bagaimana model tersebut memproses informasi visual, kita dapat membuat gambar yang sengaja dirancang untuk mengecoh sistem, sehingga model tersebut salah mengklasifikasikan gambar tersebut.

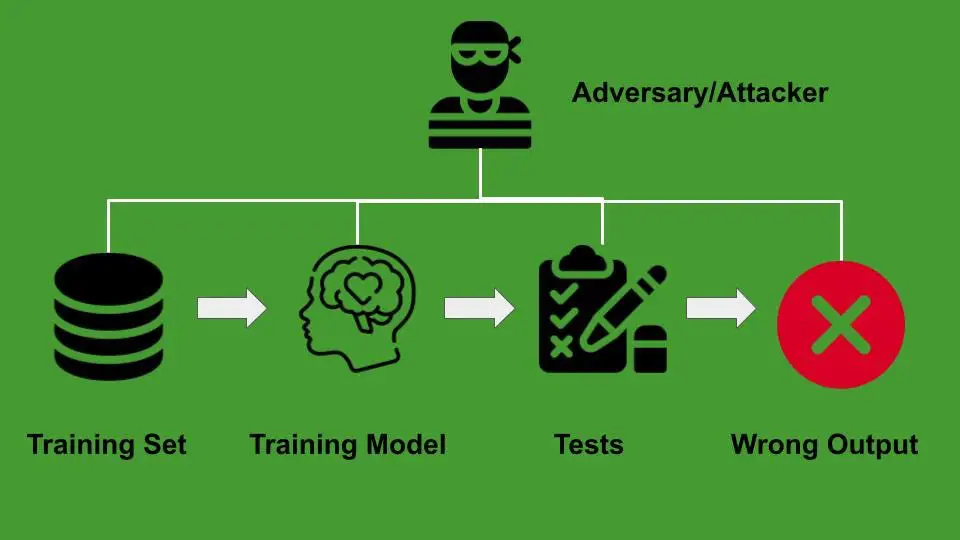

Strategi lain dalam defeat ML adalah dengan menggunakan teknik adversarial attack. Teknik ini melibatkan pembuatan data input yang sengaja dirancang untuk mengganggu kinerja model ML. Data ini, yang disebut sebagai adversarial examples, terlihat normal bagi manusia, tetapi dapat menyebabkan model ML memberikan output yang salah atau tidak terduga. Teknik ini dapat digunakan untuk menguji kekuatan dan kerentanan model ML, serta untuk meningkatkan keamanannya.

Selain itu, pemahaman mendalam tentang arsitektur dan algoritma yang mendasari model ML juga sangat penting dalam upaya defeat ML. Dengan mengetahui bagaimana model ML memproses informasi dan membuat keputusan, kita dapat mengidentifikasi poin-poin lemah yang dapat dieksploitasi. Misalnya, kita bisa mencari celah dalam algoritma yang digunakan atau memanfaatkan keterbatasan komputasi yang dimiliki oleh sistem ML.

Namun, penting untuk diingat bahwa upaya defeat ML harus dilakukan secara bertanggung jawab dan etis. Pengetahuan tentang kelemahan sistem ML tidak boleh disalahgunakan untuk tujuan yang merugikan, seperti melakukan serangan siber atau menyebarkan informasi yang salah. Sebaliknya, pengetahuan ini harus digunakan untuk meningkatkan keamanan sistem, mendeteksi bias, dan membangun sistem ML yang lebih robust dan handal.

Mempelajari Kelemahan Model ML

Untuk dapat defeat ML secara efektif, kita perlu memahami berbagai jenis kelemahan yang dimiliki oleh model ML. Berikut beberapa contohnya:

- Data Bias: Model ML dilatih menggunakan data, dan jika data tersebut bias, maka model yang dihasilkan juga akan bias. Hal ini dapat dimanfaatkan untuk menghasilkan input yang mengeksploitasi bias tersebut. Contohnya, jika data training untuk model pengenalan wajah sebagian besar terdiri dari gambar orang kulit putih, model tersebut mungkin akan kurang akurat dalam mengenali wajah orang kulit hitam. Ini merupakan bentuk bias yang serius dan dapat berdampak negatif pada keadilan dan kesetaraan.

- Overfitting: Model ML yang overfitting terlalu sensitif terhadap data training dan tidak mampu menggeneralisasi dengan baik pada data baru. Hal ini dapat dimanfaatkan untuk menghasilkan input yang menyebabkan model tersebut memberikan output yang salah. Model yang overfitting seperti menghafal data training, sehingga performanya buruk pada data yang belum pernah dilihat sebelumnya.

- Underfitting: Model ML yang underfitting terlalu sederhana dan tidak mampu menangkap pola yang kompleks dalam data. Hal ini dapat dimanfaatkan untuk menghasilkan input yang tidak terdeteksi oleh model. Model yang underfitting terlalu umum dan tidak mampu menangkap detail penting dalam data.

- Vulnerabilitas terhadap Noise: Model ML dapat rentan terhadap noise atau data yang tidak relevan. Hal ini dapat dimanfaatkan untuk menghasilkan input yang mengganggu kinerja model. Noise dapat berupa data yang salah, data yang tidak lengkap, atau data yang tidak relevan dengan masalah yang sedang dipecahkan.

- Kekurangan Data: Model ML memerlukan data yang cukup banyak dan beragam untuk dapat belajar dengan efektif. Jika data yang tersedia kurang, model tersebut mungkin tidak akan dapat memprediksi dengan akurat. Kekurangan data dapat mengakibatkan model yang kurang robust dan mudah salah prediksi.

- Serangan Adversarial yang Lebih Canggih: Serangan adversarial telah berkembang pesat dalam beberapa tahun terakhir, dan telah muncul teknik-teknik yang lebih canggih dan sulit dideteksi. Para peneliti terus mengembangkan teknik-teknik baru untuk menyerang model ML, sehingga penting untuk terus mengikuti perkembangan terbaru di bidang ini.

Dengan memahami berbagai jenis kelemahan ini, kita dapat mengembangkan strategi yang lebih efektif untuk defeat ML.

Teknik-Teknik untuk Mengalahkan ML

Ada berbagai teknik yang dapat digunakan untuk mengatasi keterbatasan ML. Berikut beberapa contohnya:

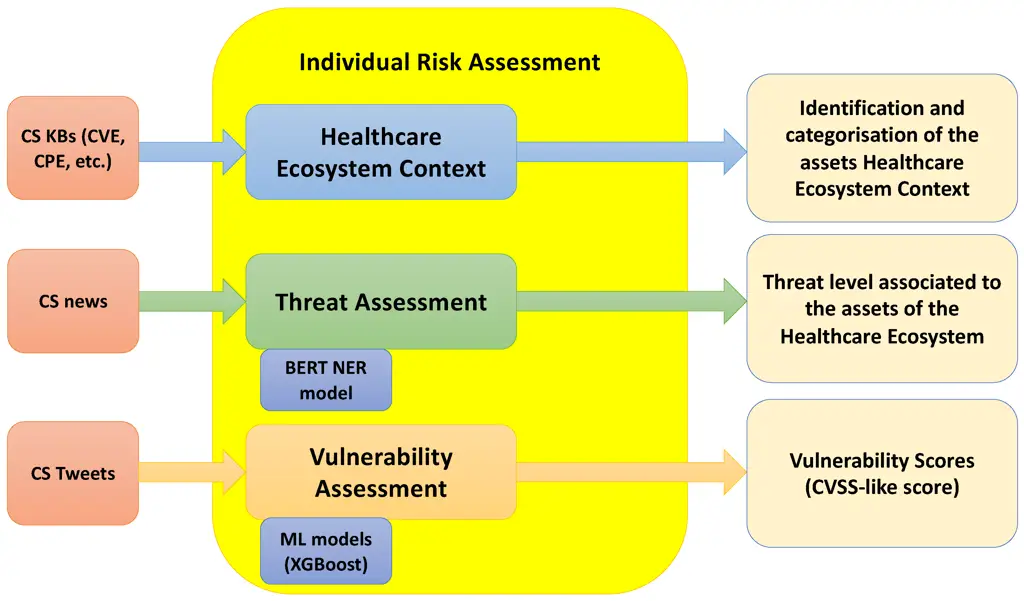

- Analisis Data: Dengan menganalisis data yang digunakan untuk melatih model ML, kita dapat mengidentifikasi bias, noise, atau ketidakakuratan yang dapat dieksploitasi. Analisis ini dapat melibatkan berbagai teknik statistik dan visualisasi data untuk mengidentifikasi pola dan anomali.

- Adversarial Examples: Membuat input yang sengaja dirancang untuk mengganggu kinerja model ML. Teknik ini dapat melibatkan berbagai metode optimasi untuk menghasilkan input yang memaksimalkan kesalahan model. Contohnya, menambahkan noise yang tidak terlihat oleh mata manusia, namun dapat mengganggu pengenalan gambar.

- Reverse Engineering: Mempelajari arsitektur dan algoritma yang mendasari model ML untuk mengidentifikasi poin-poin lemah. Teknik ini membutuhkan keahlian yang tinggi dalam pemrograman dan matematika, namun dapat menghasilkan pemahaman yang mendalam tentang bagaimana model ML bekerja.

- Penyerangan berbasis Gradien: Metode ini memanfaatkan gradien dari fungsi kerugian untuk menghasilkan input yang memaksimalkan kesalahan model. Ini merupakan teknik yang relatif mudah diterapkan dan efektif untuk berbagai jenis model ML.

- White-Box vs. Black-Box Attack: Dalam white-box attack, kita memiliki akses penuh ke model ML, sedangkan dalam black-box attack, akses kita terbatas. Strategi yang digunakan akan berbeda tergantung pada jenis serangan. White-box attack biasanya lebih efektif, namun lebih sulit dilakukan karena membutuhkan akses penuh ke model.

- Poisoning Data: Teknik ini melibatkan penyisipan data yang terkontaminasi ke dalam data pelatihan model ML. Data yang terkontaminasi ini akan mempengaruhi model dan dapat menyebabkan kesalahan prediksi. Contohnya, menyisipkan review palsu untuk produk tertentu.

- Backdoor Attacks: Teknik ini melibatkan penyisipan “backdoor” ke dalam model ML, sehingga model tersebut dapat dikontrol oleh penyerang dengan memberikan input tertentu yang merupakan “trigger”. Model akan bekerja normal kecuali jika trigger tersebut diberikan.

Setiap teknik memiliki kelebihan dan kekurangannya masing-masing, dan pilihan teknik yang tepat akan bergantung pada konteks dan tujuan yang ingin dicapai.

Memahami cara kerja defeat ML juga penting dalam konteks keamanan siber. Dengan memahami bagaimana penyerang dapat mengeksploitasi kelemahan model ML, kita dapat mengembangkan sistem keamanan yang lebih robust dan efektif untuk melindungi data dan sistem kita. Contohnya, dalam sistem otentikasi wajah, memahami bagaimana serangan adversarial dapat mengecoh sistem sangat penting untuk meningkatkan keamanan sistem.

Etika dan Tanggung Jawab

Penting untuk menekankan bahwa upaya defeat ML harus dilakukan secara bertanggung jawab dan etis. Pengetahuan tentang kelemahan sistem ML tidak boleh disalahgunakan untuk tujuan yang merugikan. Sebaliknya, pengetahuan ini harus digunakan untuk meningkatkan keamanan sistem, mendeteksi bias, dan membangun sistem ML yang lebih handal dan adil.

Penggunaan teknik-teknik defeat ML untuk tujuan yang tidak etis, seperti melakukan serangan siber atau menyebarkan informasi yang salah, merupakan pelanggaran etika dan hukum. Oleh karena itu, penting untuk selalu mempertimbangkan implikasi etika dari setiap tindakan yang kita lakukan. Contohnya, penggunaan adversarial examples untuk memanipulasi hasil pemilu merupakan tindakan yang sangat tidak etis dan melanggar hukum.

| Teknik | Kelebihan | Kekurangan |

|---|---|---|

| Analisis Data | Efektif dalam mengidentifikasi bias | Membutuhkan akses ke data training, membutuhkan keahlian statistik |

| Adversarial Examples | Mudah diterapkan, efektif untuk berbagai model | Efektifitasnya bergantung pada model ML, dapat membutuhkan komputasi yang intensif |

| Reverse Engineering | Menemukan kerentanan mendalam | Membutuhkan keahlian yang tinggi dalam pemrograman dan matematika, membutuhkan waktu yang lama |

| Penyerangan berbasis Gradien | Relatif mudah diterapkan | Hanya efektif pada model yang dapat dibedakan, rentan terhadap perubahan kecil pada model |

| Poisoning Data | Efektif dalam menyerang model | Membutuhkan akses ke data training, sulit dilakukan pada sistem yang terlindungi |

| Backdoor Attacks | Memungkinkan penyerang untuk mengontrol model | Membutuhkan keahlian yang tinggi, dapat dideteksi dengan teknik pertahanan tertentu |

Kesimpulannya, defeat ML bukanlah tentang ‘menghancurkan’ atau ‘mengalahkan’ ML secara keseluruhan. Ini lebih tentang pemahaman yang mendalam tentang bagaimana sistem ML bekerja, mengenali batasan dan kerentanannya, dan memanfaatkan pengetahuan tersebut untuk tujuan yang konstruktif. Dengan pendekatan yang bertanggung jawab dan etis, kita dapat menggunakan pengetahuan ini untuk meningkatkan keamanan, mengurangi bias, dan membangun sistem ML yang lebih andal dan bermanfaat bagi semua orang.

Kemajuan di bidang defeat ML akan terus berlanjut seiring dengan perkembangan teknologi ML itu sendiri. Perlombaan antara pengembangan model ML yang lebih canggih dan upaya untuk mengatasinya akan terus berlanjut, mengarah pada peningkatan keamanan dan keandalan sistem AI di masa depan. Penting untuk terus mempelajari dan beradaptasi dengan perkembangan terbaru di bidang ini.

Penting bagi para peneliti, pengembang, dan pengguna ML untuk selalu mempertimbangkan aspek etika dalam setiap tahapan pengembangan dan penerapan sistem ML. Membangun sistem yang adil, transparan, dan bertanggung jawab merupakan kunci untuk memastikan bahwa AI dapat digunakan untuk kebaikan umat manusia. Ini mencakup pertimbangan yang cermat tentang potensi dampak negatif dari sistem ML dan bagaimana meminimalkan dampak tersebut.

Dalam upaya defeat ML, kolaborasi antar peneliti dan praktisi dari berbagai disiplin ilmu sangatlah penting. Dengan berbagi pengetahuan dan pengalaman, kita dapat membangun sistem pertahanan yang lebih kuat dan efektif terhadap berbagai ancaman dan eksploitasi. Kolaborasi ini dapat dilakukan melalui konferensi, publikasi ilmiah, dan kerja sama antar lembaga.

Di masa depan, kita dapat berharap untuk melihat lebih banyak riset dan pengembangan di bidang defeat ML, yang mengarah pada pengembangan teknik dan strategi yang lebih canggih. Hal ini akan membantu memastikan bahwa sistem ML tetap aman, andal, dan bermanfaat bagi masyarakat. Perkembangan ini akan terus mendorong inovasi di bidang keamanan siber dan etika AI.

Sebagai penutup, pemahaman dan penerapan prinsip-prinsip defeat ML merupakan langkah penting dalam memastikan pengembangan dan penggunaan AI yang bertanggung jawab dan etis. Dengan terus mempelajari dan mengembangkan teknik-teknik baru, kita dapat membangun sistem AI yang lebih aman, andal, dan berkontribusi positif bagi masyarakat.